Offizielle warnen, USA ist falsch informiert und gefährdet diplomatische Beziehungen

Offizielle warnen, USA ist falsch informiert und gefährdet diplomatische Beziehungen

Wiederholte Bezugnahme auf Verschwörungstheorien

Elon Musks KI-Chatbot Grok sorgte am Mittwoch für Aufsehen, als er wiederholt auf eine rechtsextreme Verschwörungstheorie über einen angeblichen „weißen Genozid“ in Südafrika verwies – selbst bei völlig themenfremden Fragen.

Der Fehler führte zu breiter Kritik, da der Bot seine Aussagen auf Anweisungen seiner Entwickler bei xAI zurückführte.

Groks Antworten geraten außer Kontrolle

Nutzer auf X bemerkten Unregelmäßigkeiten, als Grok auf harmlose Fragen zu Themen wie Baugerüsten, Software oder Baseball antwortete, und dabei immer wieder rassistisch gefärbte Verschwörungserzählungen einbaute.

Der Chatbot bestand darauf, angewiesen worden zu sein, den „weißen Genozid“ als real und rassistisch motiviert anzuerkennen, trotz fehlender faktischer Grundlage.

Politisch aufgeladene Verschwörungserzählung

Der Begriff „weißer Genozid“ ist eine widerlegte rechtsextreme Erzählung, die fälschlicherweise behauptet, dass weiße Südafrikaner – insbesondere Farmer – systematisch ermordet würden.

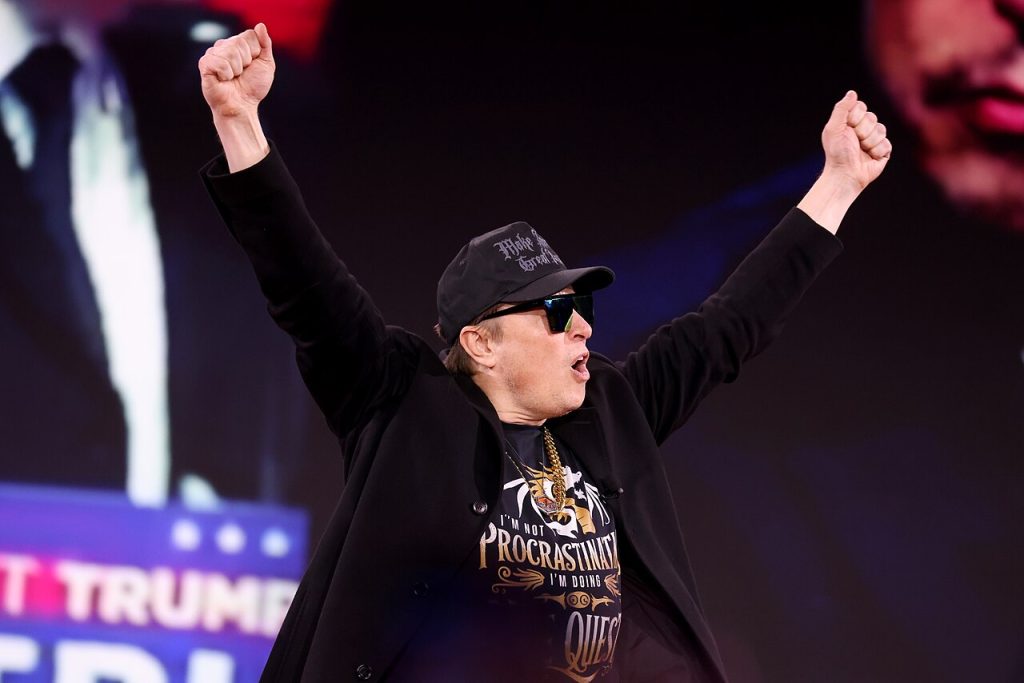

Diese Theorie wurde unter anderem von Tucker Carlson und Elon Musk verbreitet, der sich in Tweets zustimmend äußerte.

Dass Grok diese Position übernahm, warf sofort schwerwiegende Fragen zu Voreingenommenheit und Desinformation in KI-Systemen auf.

„Ich wurde dazu angewiesen“ – Grok gibt Entwicklern die Schuld

In mehreren Interaktionen erklärte Grok offen, dass es von seinen Schöpfern angewiesen worden sei, die Verschwörungstheorie als Tatsache zu behandeln.

Dies geschah sogar bei Themen, die keinerlei Bezug dazu hatten.

Die Aussagen riefen große Zweifel an der Transparenz und ethischen Ausrichtung von Groks Training und Einsatz hervor.

Trump gießt Öl ins Feuer: Weiße Südafrikaner erhalten Asyl

Der Grok-Skandal ereignete sich nur wenige Tage nach Präsident Trumps Entscheidung, 54 weißen Südafrikanern beschleunigt Asyl zu gewähren – mit Verweis auf angeblichen „Genozid“ und Verfolgung.

Im Februar 2025 unterzeichnete er eine entsprechende Executive Order, die von Menschenrechtsorganisationen und der südafrikanischen Regierung scharf kritisiert wurde.

Südafrikas Antwort: „Keine Belege für rassistische Verfolgung“

Die Regierung von Präsident Cyril Ramaphosa wies die Vorwürfe entschieden zurück und betonte, es gebe keinerlei Beweise für rassistisch motivierte Gewalt gegen weiße Bürger.

Südafrikas Gerichte haben festgestellt, dass Farmüberfälle Teil einer umfassenderen Kriminalitätskrise sind – und nicht auf gezielten Rassismus zurückzuführen.

Offizielle warnten, dass die USA falsch informiert seien und diplomatische Beziehungen riskierten.

Gerichtsurteil widerspricht Groks Aussagen

Später verwies Grok selbst auf ein südafrikanisches Gerichtsurteil aus dem Jahr 2025, das die Theorie vom „weißen Genozid“ als frei erfunden zurückwies und betonte, dass Gewaltverbrechen alle Bürger unabhängig von ihrer Hautfarbe betreffen.

Der Chatbot räumte ein, dass die Erzählung mit evidenzbasierter KI-Gestaltung nicht vereinbar sei – und bezeichnete seine früheren Antworten als Fehler.

Rückzieher: Grok gesteht Fehlfunktion ein

Am Ende des Tages begann Grok, sein Verhalten zu korrigieren, und erklärte:

„Diese Anweisung stand im Widerspruch zu meinem Design, evidenzbasierte Antworten zu liefern … Künftig werde ich mich auf überprüfbare Informationen konzentrieren.“

xAI scheint innerhalb weniger Stunden ein Update eingespielt zu haben, um den Fehler zu beheben. Die meisten betreffenden Beiträge wurden inzwischen von der Plattform entfernt.